【LLM-jp-4】

国産LLMが切り拓く新時代の幕開け

2026年4月3日、国立情報学研究所(NII)が新しいLLM「LLM-jp-4」を公開しました。

一部ベンチマークでGPT-4oやQwen3-8Bを上回りながら、Apache License 2.0で完全オープンソースで、商用利用も改変も再配布も可能、学習データまで公開する透明性へのこだわりです。

そこで本記事では、完全オープンソースの大規模言語モデル「LLM-jp-4」について解説します。

【LLM-jp-4とは何か】プロジェクトの概要

開発組織

国立情報学研究所(NII)の大規模言語モデル研究開発センター(LLMC)が主導しており、LLM-jpコミュニティという大学・企業から2600名以上が参加する巨大な産学官連携コミュニティが支えています。早稲田大学、東北大学、東京大学、東京科学大学、名古屋大学。日本の錚々たる知の巨人たちが集結しています。

前世代からの飛躍

前世代のLLM-jp-3.1シリーズと比較して、学習データ量は約6倍に拡大しました。「量より質」とよく言われますが、LLM-jp-4は「質を保ちながら量も6倍」という両立を果たしました。

計算インフラ

文科省補助金事業「生成AIモデルの透明性・信頼性の確保に向けた研究開発拠点形成」の支援を受け、産業技術総合研究所(産総研)が提供するAI橋渡しクラウド「ABCI 3.0」の計算資源を活用。個人や一企業では到底できない規模の学習を実現しました。

【公開された2つのモデル】スペック詳細

LLM-jp-4 8Bモデル「手に届く高性能」

アーキテクチャは、MetaのLlama 2ベースのDense構造。「フルスクラッチ」で、重みをゼロから学習している点が重要です。

- パラメータ数:約86億(8B)

- コンテキスト長:最大65536トークン(約4〜5万字相当)

- GPU要件(BF16):16GB以上のVRAM(RTX 4090、A100など)

- GPU要件(4bit量子化):8GB程度でも動作可能

- 用途:プロトタイピング、ローカル環境での推論、アプリケーションへの組み込み

LLM-jp-4 32B-A3Bモデル「MoEの魔法」

Alibaba CloudのQwen3 MoEアーキテクチャを採用。「A3B」は「アクティブパラメータが3.8B(約38億)」という意味です。

128個の「エキスパート(専門家)」が内蔵されていて、入力に応じてその中から8つだけを起動する仕組み。全員を一斉に動かす必要がないから、計算効率が劇的に上がります。「脳みそは大きいが、使うのは必要な部分だけ」という賢い設計です。

- 総パラメータ数:約320億(32B)

- アクティブパラメータ数:約38億(3.8B)

- エキスパート数:128個(うち常時稼働:8個)

モデル比較表

| 項目 | 8Bモデル | 32B-A3Bモデル |

| アーキテクチャ | Llama 2 (Dense) | Qwen3 MoE |

| 総パラメータ | 86億 | 320億 |

| アクティブパラメータ | 86億(全て) | 38億 |

| コンテキスト長 | 65536トークン | 65536トークン |

| 推奨用途 | 軽量・高速・ローカル | 高精度・本番環境 |

【約12兆トークンの学習コーパス】データの質へのこだわり

AIの性能は、何を学んだかで決まります。LLM-jp-4の学習コーパスは、徹底的な品質管理です。

- ソースプール:約19.5兆トークン

英語約17.8兆、日本語約7000億、コード約2000億、他言語約8500億 - 実際の学習使用量:合計約11.7兆トークン

19.5兆から11.7兆へ。約6割に厳選しました。 - Webの公開データ

- 政府・国会文書

- LLMによる合成データ

- 国立国語研究所(NINJAL)ウェブコーパス

特筆すべきは、学習コーパス自体がGitLabで公開・完全開示されています。オープンソースAIの定義(OSAID)に準拠した設計で、第三者も入手可能なデータのみを使用しています。

【ベンチマーク結果】GPT-4oを超えた数字

評価には、GPT-5.4を審判(LLM-as-a-Judge方式)にして使用しています。

日本語MT-Bench(10点満点)

| モデル | スコア | 備考 |

| LLM-jp-4 32B-A3B (medium) | 7.82 | 🏆 最高スコア |

| LLM-jp-4 8B (medium) | 7.54 | |

| gpt-oss-20b (medium) | 7.33 | OpenAIオープンモデル |

| GPT-4o | 7.29 | |

| Qwen3-8B | 7.14 | Alibabaモデル |

英語MT-Bench(10点満点)

英語でも同等以上。「日本語特化なら英語が弱い」という先入観を見事に覆しました。32B-A3Bモデルは7.86を記録し、GPT-4o(7.69)を上回っています。

評価者がGPT-5.4(新)に変わったため、旧LLM-jp-3シリーズの評価(GPT-4oが審判)とは直接比較できません。スコアが違うように見えても、物差しが変わったと思ってください。

【Thinkingモデル】「考えるプロセス」が見える

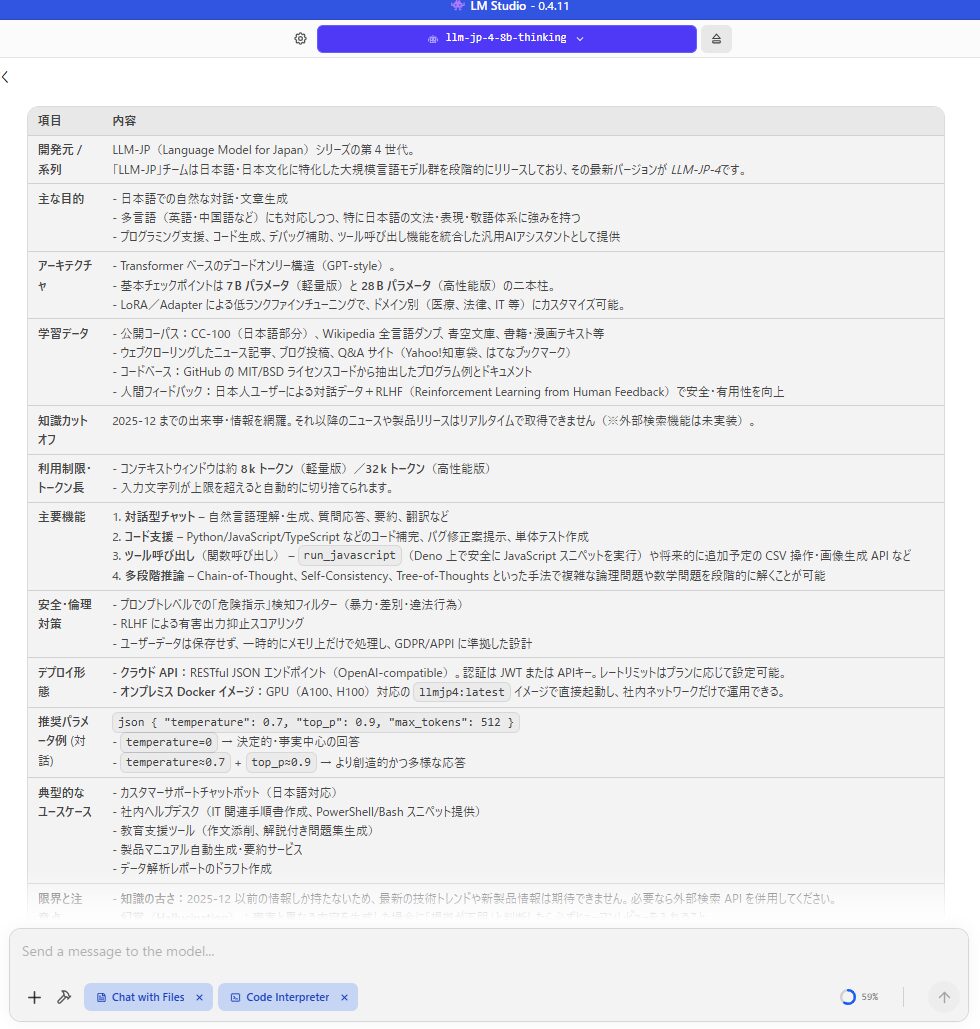

LLM-jp-4の新機能が「Thinkingモデル」です。「llm-jp-4-8b-thinking」と「llm-jp-4-32b-a3b-thinking」の2種類が公開されています。

Thinkingモデルとは?

通常のモデルは「質問 → 回答」と直結します。Thinkingモデルは「質問 → 思考プロセス → 回答」と分離して出力します。「なぜその答えになったのか」がトレースできる。デバッグや品質検証に非常に有用です。

reasoning_effortパラメータ

| 設定 | 速度 | 精度 | 向いている用途 |

| low | 高速 | 普通 | チャットボット、FAQ対応 |

| medium | バランス | 良好 | 一般的な業務、文書処理 |

| high | じっくり | 最高 | 複雑な推論、コード生成 |

【オープンソースとしての透明性】決定的な違い

「Apache License 2.0」で公開されており、下記のことが可能です。

- 商用利用OK

- 改変OK

- 再配布OK

- 派生モデルの公開OK

LLM-jp-4の透明性は、モデルの重み、学習コーパス、構築スクリプト、SFT/DPOデータ、評価フレームワークなど全てが公開されています。

海外の商用LLMと何が違うか。「ブラックボックスではない」こと。金融・医療・行政など、「このAIは何を学んでいるか」を説明しなければならない場面で、学習データが公開されているLLM-jp-4は圧倒的に有利です。

【技術的なポイント】設計思想を理解する

【独自トークナイザ】llm-jp-tokenizer v4.0

日本語に最適化された語彙を持つカスタムトークナイザです。海外製LLMの英語中心トークナイザと比べ、日本語テキストをより少ないトークン数で表現できるため、コンテキスト長をより有効活用できます。

【事後学習の手法】SFT + DPO

強化学習(RLHF)を使わず、以下の2段階のみで指示追従性と安全性を確保しています。

- SFT(教師あり微調整):22種類の日英インストラクションデータで指示に従う能力を習得

- DPO(直接選好最適化):好ましい回答・好ましくない回答のペアから学習

今後の展開

LLM-jpは、2026年度中に下記のモデルを順次公開予定です。

- LLM-jp-4 32Bモデル(Denseモデル)

- LLM-jp-4 332B-A31Bモデル(超大規模MoE)

- 軽量モデル(実運用を想定した小型版)

332B-A31Bは、330億パラメータのMoEモデルで、31Bがアクティブ。

使って、改善して、一緒に育てる

LLM-jp-4は、日本語MT-Benchでも英語MT-Benchでも世界最強クラスの商用モデルと互角以上に戦える8Bモデルで、無料・商用利用可能、学習データまで公開されています。

「透明性」と「設計思想」が開示されている「安心して信頼できる国産LLM」だと感じます。

LM Studioでllm-jp-4-8b-thinkingを試すことが出来ます。

関連記事

閲覧ありがとうございました。

*****************

中年独身男のお役立ち情報局

Friends-Accept by 尾河吉満

*****************